Список когнитивных искажений

Наткнулся в Википедии на совершенно замечательную подборку психологических дефектов, встречающихся в обществе. Да что в обществе — в каждом из нас встречаются некоторые из этих перечисленных искажений

Принятие решений и искажения, связанные с поведением

Эффект повального увлечения, конформизм — тенденция делать (или верить в) вещи, потому что много других людей делают это (или верят в это). Относится к групповому мышлению, стадному поведению и маниям.

Ошибка, связанная с частными примерами — игнорирование доступных статистических данных, в пользу частных случаев.

Слепое пятно в отношении когнитивных искажений — тенденция не компенсировать свои собственные когнитивные искажения.

Искажение в восприятии сделанного выбора — тенденция помнить свои выборы как более правильные, чем они были на самом деле.

Рационализация после покупки — тенденция убеждать себя с помощью рациональных аргументов, что покупка стоила своих денег.

Отвращение к потере — отрицательная полезность, связываемая с потерей объекта, оказывается больше, чем полезность, связанная с приобретением его.

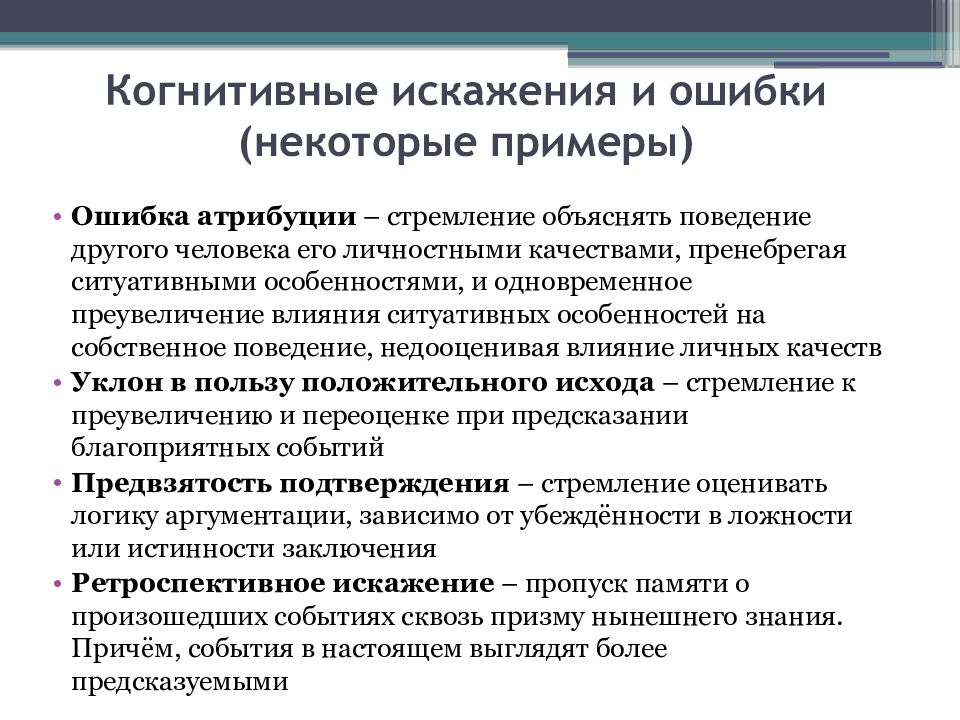

Предвзятость подтверждения (Confirmation bias) — тенденция искать или интерпретировать информацию таким образом, чтобы подтвердить имевшиеся заранее концепции.

Систематическая ошибка согласованности — тенденция проверять гипотезы исключительно путём прямого тестирования, вместо того, чтобы тестировать возможные альтернативные гипотезы.

Профессиональная деформация — психологическая дезориентация личности в ходе профессиональной деятельности.

Тенденция смотреть на вещи согласно правилам, общепринятым для своей профессии, отбрасывая более общую точку зрения. Наиболее ей подвержены лица, работающие с людьми (полиция/милиция, соц.работники, учителя, медики, психологи и т.п)[источник не указан 154 дня].

Тенденция смотреть на вещи согласно правилам, общепринятым для своей профессии, отбрасывая более общую точку зрения. Наиболее ей подвержены лица, работающие с людьми (полиция/милиция, соц.работники, учителя, медики, психологи и т.п)[источник не указан 154 дня].Эффект вклада — тот факт, что люди часто хотят продать некий объект гораздо дороже, чем они готовы заплатить, чтобы приобрести его.

Отвращение к крайним решениям — тенденция избегать экстремальных решений, выбирая промежуточные.

Эффект фокусировки — ошибка в предсказаниях, возникающая, когда люди уделяют слишком много внимания какому-то одному аспекту явления; вызывает ошибки в правильном предсказании полезности будущего исхода. Например, концентрация внимания на том, кто виноват в возможной ядерной войне, отвлекает внимание от того, что пострадают в ней все.

Эффект узких рамок — использование слишком узкого подхода или описания ситуации или проблемы. Эффект воздействия рамок — различные выводы в зависимости от того, как данные представлены.

Гиперболический уровень дискаунта (англ.)русск. — тенденция людей тем больше предпочитать более близкие во времени выплаты относительно выплат в более отдаленном будущем, чем ближе обе выплаты к настоящему времени.

Переоценка воздействия — тенденция людей переоценивать длительность или интенсивность воздействия некого события на их будущие переживания.

Уклон в сторону поиска информации — тенденция искать информацию даже тогда, когда она не влияет на действия.

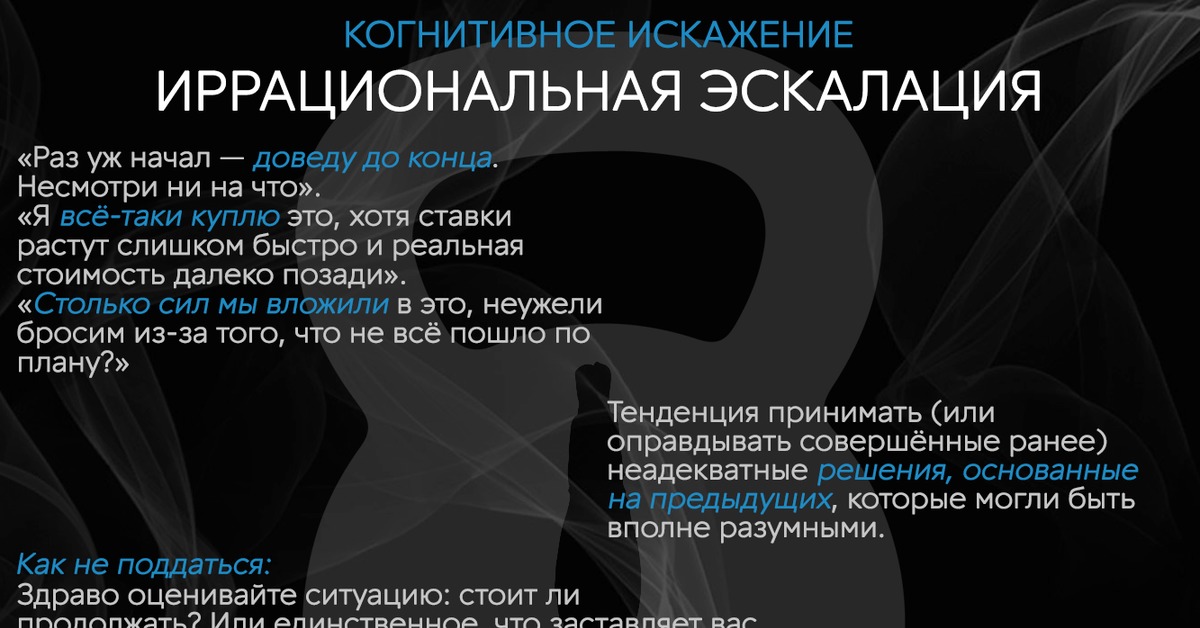

Иррациональное усиление — тенденция принимать иррациональные решения, основанные на прошлых рациональных решениях, или оправдание уже совершённых действий.

Эффект знакомства с объектом — тенденция людей выражать необоснованную симпатию к некому объекту только потому, что они знакомы с ним.

Эффект морального доверия — человек, относительно которого известно, что у него нет предубеждений, имеет в будущем большие шансы проявить предубеждения. Иначе говоря, если все (в том числе он сам) считают человека безгрешным, то у него возникает иллюзия, что его любое действие также будет безгрешным.

Потребность в завершении — потребность достигнуть завершения в важном вопросе, получить ответ и избежать чувства сомнений и неуверенности. Текущие обстоятельства (время или социальное давление) могут усилить этот источник ошибок.

Отрицание вероятности — тенденция полностью отвергать вероятностную проблематику при принятии решений в условиях неопределённости.

Недооценка бездействия — тенденция оценивать вредоносные действия как худшие и менее моральные, чем в равной степени преступное бездействие.

Ошибка при планировании — тенденция недооценивать время выполнения задач. Также известно как следствие закона Мёрфи: «Всякая работа требует больше времени, чем вы думаете».

Эффект псевдоуверенности — тенденция принимать решения, избегающие риска, если ожидаемый результат позитивный, однако принимать рискованные решения, чтобы избежать негативного исхода.

Сопротивление, «дух противоречия»

Селективное восприятие — тенденция, состоящая в том, что ожидания влияют на восприятие.

Отклонение в сторону статуса кво — тенденция людей желать, чтобы вещи оставались приблизительно теми же самыми.

Предпочтение целостных объектов — потребность закончить данную часть задачи. Ярко проявляется в том, что людям свойственно есть больше, когда предлагаются большие порции еды, чем брать много маленьких порций.

Предпочтение нулевого риска — предпочтение уменьшить какой-то один маленький риск до нуля вместо того, чтобы значительно уменьшить другой, больший риск. Например, большинство людей предпочли бы уменьшить вероятность террористических актов до нуля вместо снижения аварийности на дорогах, даже если бы второй эффект давал бы больше сохранённых жизней. Другой распространённый пример — ятрофобия: многие люди боятся осложнений медицинских вмешательств больше, чем заболевания или смерти в результате естественных причин, независимо от данных статистики.

Подчинение авторитету — склонность людей подчиняться авторитету, игнорируя свои собственные суждения о целесообразности действия. Смотрите также эксперимент Милгрэма.

Искажения, связанные с вероятностями и верованиями

Многие из этих когнитивных искажений часто исследуются в связи с тем, как они влияют на бизнес и как они влияют на экспериментальные исследования.

Когнитивное искажение в условиях неоднозначности — избегание вариантов действий, в которых отсутствующая информация делает вероятность «неизвестной».

Отклонение, связанное со вниманием — пренебрежение релевантной информацией при суждении о корреляции или ассоциации.

Эвристика доступности — оценка как более вероятного того, что более доступно в памяти, то есть уклонение в сторону более яркого, необычного или эмоционально заряженного.

Каскад доступной информации

Иллюзия кластеризации — тенденция видеть паттерны там, где их на самом деле нет.

Ошибка полноты распределения — тенденция верить, что чем ближе среднее значение к заданному, тем уже распределение набора данных.

Ошибка совпадений — тенденция полагать, что более специальные случаи являются более вероятными, чем более частными.

Ошибка игрока — тенденция полагать, что отдельные случайные события испытывают влияние предыдущих случайных событий.

Хоторнский эффект — феномен, состоящий в том, что люди, наблюдаемые в ходе исследования, временно изменяют своё поведение или производительность. Пример: повышение производительности труда на заводе, когда приезжает комиссия по исследованию производительности труда на этом заводе.

Эффект знания задним числом — иногда называется «Я так и знал, что так будет» (как вариант — «А ведь я говорила…») — склонность воспринимать прошлые события предсказуемыми.

Иллюзия корреляции — ошибочная вера во взаимосвязь определённых действий и результатов.

Ошибочность, связанная с играми — анализ проблем, связанных с выпадением шансов, с помощью узкого набора игр.

Эффект ожидания наблюдателя — этот эффект возникает, когда исследователь ожидает определённого результата и бессознательно манипулирует ходом эксперимента или неправильно интерпретирует данные, чтобы обнаружить этот результат (см. также эффект ожиданий субъекта).

Отклонение, связанное с оптимизмом — тенденция систематически переоценивать и быть сверхоптимистичным относительно шансов успеха планируемых действий.

Эффект сверхуверенности — тенденция переоценивать свои собственные способности.

Отклонение в сторону позитивного исхода — тенденция переоценивать при предсказании вероятность хороших вещей.

Эффект первенства — тенденция переоценивать изначальные события более, чем последующие события.

Эффект недавнего — тенденция оценивать значение недавних событий выше, чем более ранних событий.

Недооценка возвращения величины к среднему значению — тенденция ожидать, что экстраординарное поведение системы продолжится.

Эффект воспоминаний — эффект, состоящий в том, что люди помнят больше событий из своей молодости, чем из других жизненных периодов.

Приукрашивание прошлого — тенденция оценивать прошлые события более позитивно, чем они воспринимались в тот момент, когда на самом деле происходили.

Искажение, связанное с селекцией — искажение в экспериментальных данных, которое связано с тем, каким образом данные были собраны.

Ошибка выжившего (survivorship bias) — возможность недооценивать свою уязвимость на основании своего выживания в тех или иных ситуациях, в действительности объясняющегося лишь законами вероятности и естественным отбором.

Стереотипизация — ожидание от члена группы определённых характеристик, без знания какой-либо дополнительной информации о его индивидуальности.

Эффект субаддитивности — тенденция оценивать вероятность целого в качестве меньшей, чем вероятности составляющих его частей.

Субъективное придание значимости — восприятие чего-либо, как истинного, если верования субъекта требуют, чтобы это было истинным. Сюда также входит восприятие совпадений как взаимосвязи.

Эффект телескопа — этот эффект состоит в том, что недавние события кажутся более отдалёнными, а более дальние события — более близкими во времени.

Ошибочность в духе меткого стрелка из Техаса — выбор или подстройка гипотезы после того, как данные собраны, что делает невозможным проверить гипотезу честно.

Социальные искажения

Большинство из этих искажения связаны с ошибками атрибуции.

Искажение в оценке роли субъекта действия — тенденция при объяснении поведения других людей чрезмерно подчёркивать влияние их профессиональных качеств и недооценивать влияние ситуации (см. также фундаментальная ошибка атрибуции). Однако парной к этому искажению является противоположная тенденция при оценке собственных поступков, при которой люди переоценивают влияния на них ситуации и недооценивают влияние своих собственных качеств.

Эффект Даннинга-Крюгера — «когда люди некомпетентны в выбранных ими стратегиях достижения успеха, они терпят двойной удар: они не только приходят к ошибочным заключениям и делают неудачные выборы, но также их некомпетентность лишает их возможности осознать это. Вместо этого они остаются с ошибочным впечатлением, что всё в порядке. (см. также эффект озера Вобегон и эффект сверхуверенности.)

Эффект эгоцентричности — он имеет место, когда люди считают себя более ответственными за результат неких коллективных действий, чем это находит внешний наблюдатель.

Эффект Форера (а также эффект Барнума) — тенденция высоко оценивать точность описаний своей личности, как если бы они были нарочно выкованы специально для них, но которые в действительности являются достаточно общими, чтобы их можно было приложить к очень большому числу людей. Например, гороскопы.

Эффект фальшивого консенсуса — тенденция людей переоценивать ту степень, в которой другие люди соглашаются с ними.

Фундаментальная ошибка атрибуции — тенденция людей переоценивать объяснения поведения других людей, основанные на их личностных качествах, и в то же время недооценивать роль и силу ситуационных влияний на то же самое поведение (см. также Искажение в оценке роли субъекта действия, ошибку групповой атрибуции, эффект позитивности и эффект негативности.)

Эффект ореола — имеет место при восприятии одного человека другим и состоит в том, что позитивные и негативные черты человека «перетекают», с точки зрения воспринимающего, из одной области его личности в другую. (см. также стереотип физической привлекательности).

Стадный инстинкт — распространённая тенденция принимать мнения и следовать за поведением большинства, чтобы чувствовать себя в безопасности и избегать конфликтов.

Иллюзия асимметричной проницательности — человеку кажется, что его знание о своих близких превосходит их знание о нём.

Иллюзия прозрачности — люди переоценивают способность других понимать их, и они также переоценивают свою способность понимать других.

Искажение в пользу своей группы — тенденция людей отдавать предпочтение тем, кого они считают членом своей собственной группы.

Феномен «справедливого мира» — тенденция людей верить, что мир «справедлив» и следовательно люди получают «то, что они заслуживают».

Эффект озера Вобегон — человеческая тенденция распространять льстивые верования о себе и считать себя выше среднего. (см. также хуже-чем-в-среднем эффект и эффект сверхуверенности).

Искажение в связи с формулировкой закона — эта форма культурного искажения связана с тем, что запись некого закона в виде математической формулы создаёт иллюзию его реального существования.

Искажение в оценке гомогенности членов другой группы — люди воспринимают членов своей группы как относительно более разнообразных, чем члены других групп.

Искажение в связи с проекцией — тенденция бессознательно полагать, что другие люди разделяют те же, что и субъект, мысли, верования, ценности и позиции.

Искажение в собственную пользу — тенденция признавать большую ответственность за успехи, чем за поражения. Это может проявляться также как тенденция людей преподносить двусмысленную информацию благоприятным для себя образом (См. также искажение в пользу группы.)

Самосбывающиеся пророчества — тенденция вовлекаться в те виды деятельности, которые приведут к результатам, которые (сознательно или нет) подтвердят наши верования.

Оправдание системы — тенденция защищать и поддерживать статус кво, то есть тенденция предпочитать существующие социальное, политическое и экономическое устройство, и отрицать перемены даже ценой жертвования индивидуальными и коллективными интересами.

Искажение при описании черт характера — тенденция людей воспринимать себя как относительно изменчивых в отношении личных качеств, поведения и настроения, одновременно воспринимая других как гораздо более предсказуемых.

Эффект первого впечатления — влияние мнения о человеке, которое сформировалось у субъекта в первые минуты при первой встрече, на дальнейшую оценку деятельности и личности этого человека. Причисляют также к ряду ошибок, часто совершаемых исследователями при использовании метода наблюдения наряду с эффектом ореола и другими.

Ошибки памяти

Благодетель — восприятие себя как ответственного за желательные исходы, но не ответственного за нежелательные. (Термин предложен Гринвальдом (1980)) (Смотри Искажение самовозвеличения.)

Кажущееся постоянство — неправильное воспоминание чьих-либо прошлых позиций и поведения как напоминающих теперешние позиции и поведение.

Криптомнезия — форма неправильного установления авторства, когда воспоминание ошибочно принимается за результат воображения. Например, человеку может казаться, что он сам сочинил анекдот, в то время, как в действительности он его уже слышал и просто вспомнил.

Эгоцентрическое искажение — воспоминание прошлого в самовозвеличивающей манере, например, воспоминание экзаменационных оценок лучшими, чем они были, а пойманной рыбы — большей, чем она была.

Ложная память — принятие неизвестного за известное.

Ретроспективное искажение — фильтрация памяти о прошлых событиях сквозь теперешнее знание. При этом события выглядят более предсказуемыми, чем они были в действительности. Известно также как ‘эффект Я-всё-это-знал’.

Внушаемость — форма неправильного установления авторства, когда идеи, на которые намекнул спрашивающий, неверно воспринимаются как вспомненные.

А вот и сама статья, дополненная призывом технолога Википедии пожертвовать бабло сервису, считающему эту статью плохой.

Человеку, написавшую статью, однозначный респект. Жаль только, Википедия относится к личности очень неубедительно.

страшные слова или первый помощник в продуктовом дизайне — часть 1

В работе над своим сервисом у нас регулярно возникают вопросы: откуда взять хорошие идеи, как развивать продукт? Как появляются правильные гипотезы? Проблема в том, что у нас просто физически нет времени тестировать все гипотезы, чтобы путем проб и ошибок найти лучшие. От пользователя эту информацию так же получить невозможно, так как в работе над новым — наша задача предугадывать.

От пользователя эту информацию так же получить невозможно, так как в работе над новым — наша задача предугадывать.

Как человек принимает решение? Очевидно, что понимание этого – ключ к правильному развитию вашего продукта. Какие есть паттерны поведения, как ими пользоваться, чтобы понимать, куда развивать продукт. Как встраиваться в существующие паттерны и создавать новые?

Поиск ответов на все эти вопросы – это, наверное, основная функция продуктового дизайнера.

В работе над tagvisor.com мы хотим научиться читать мысли своей аудитории. Здесь мы подходим к теме когнитивной психологии.

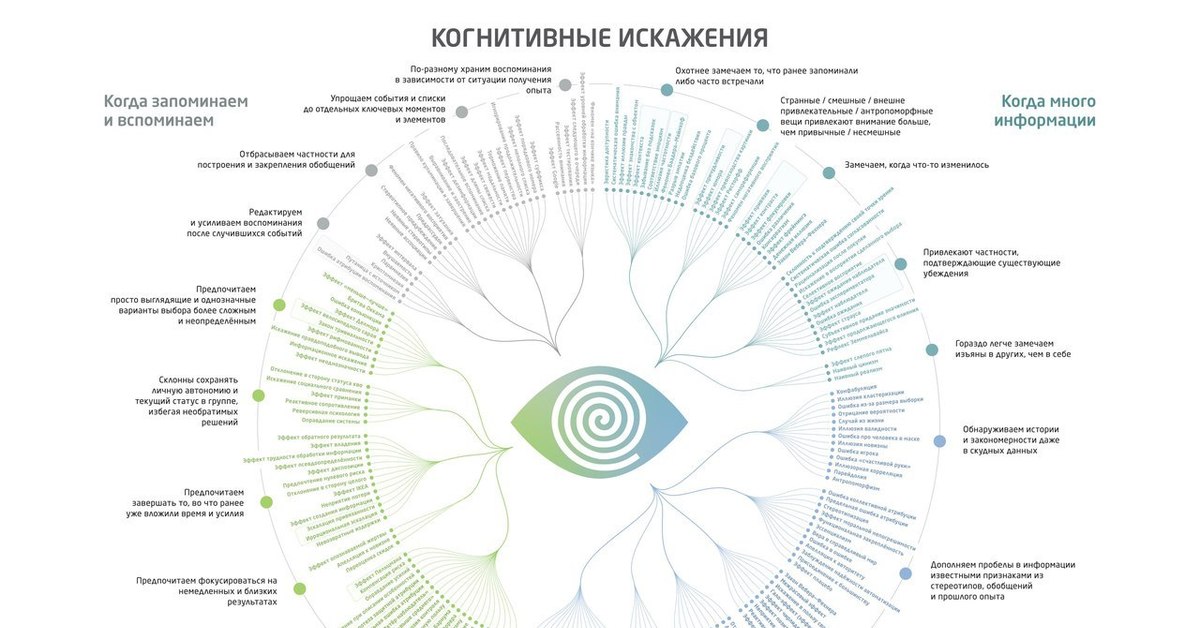

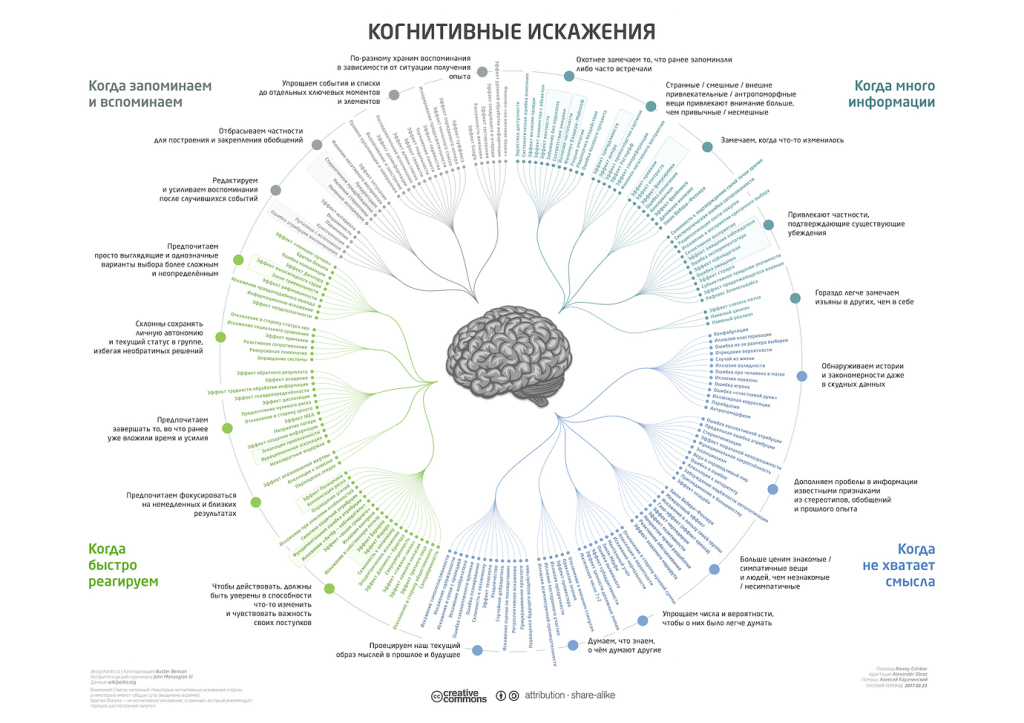

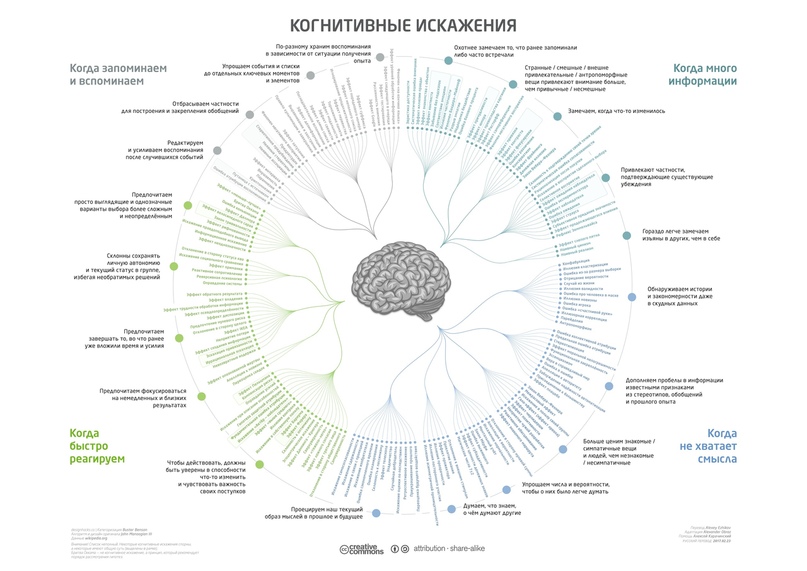

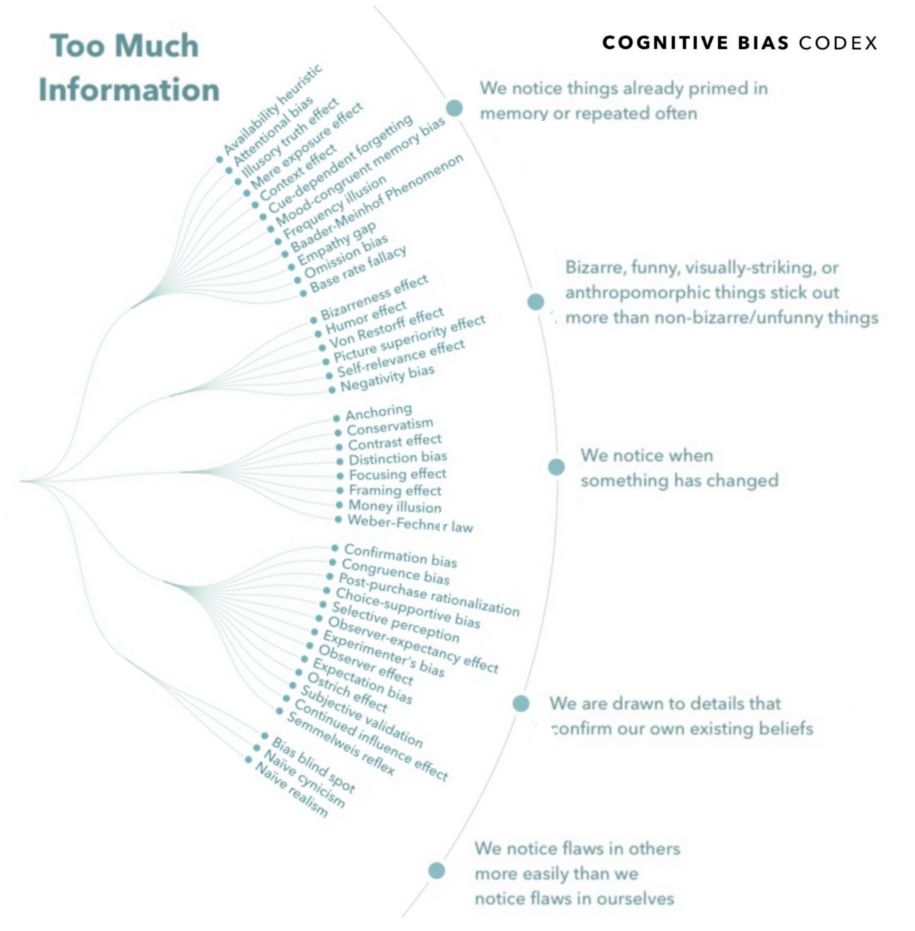

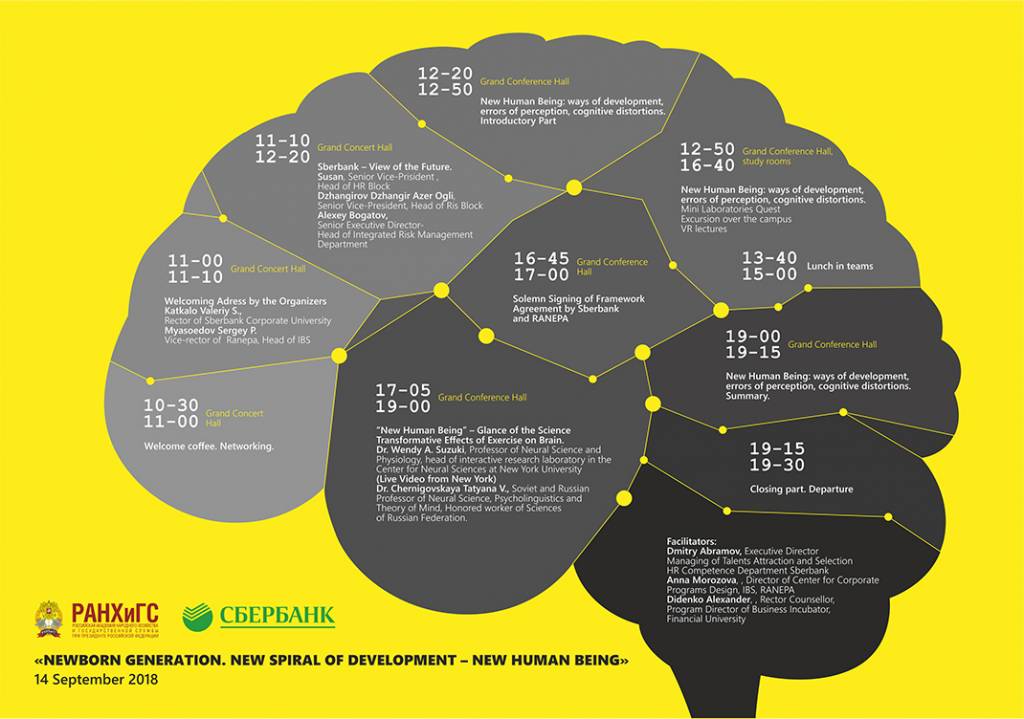

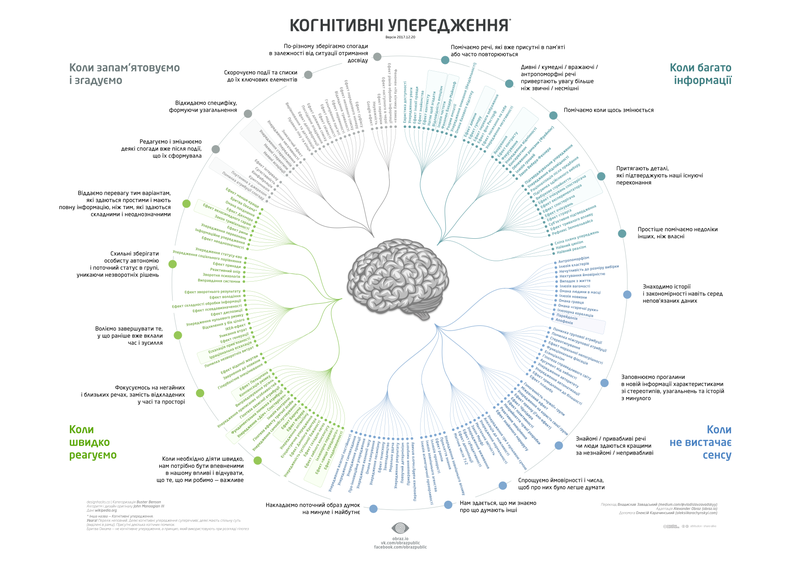

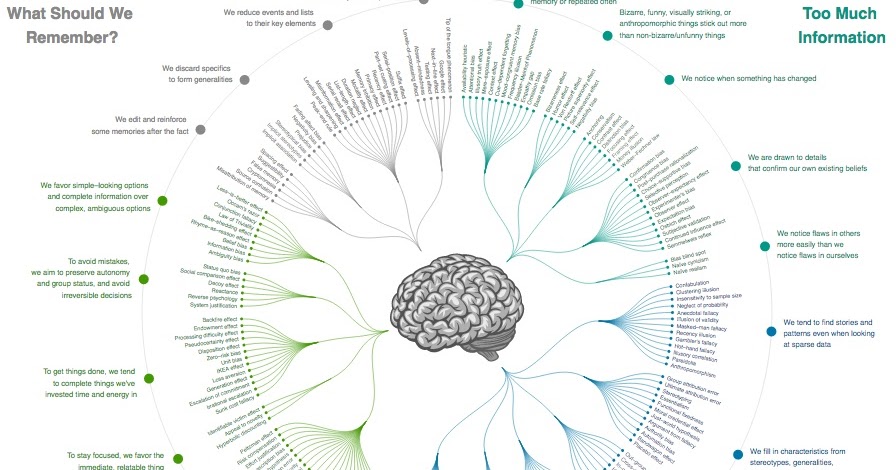

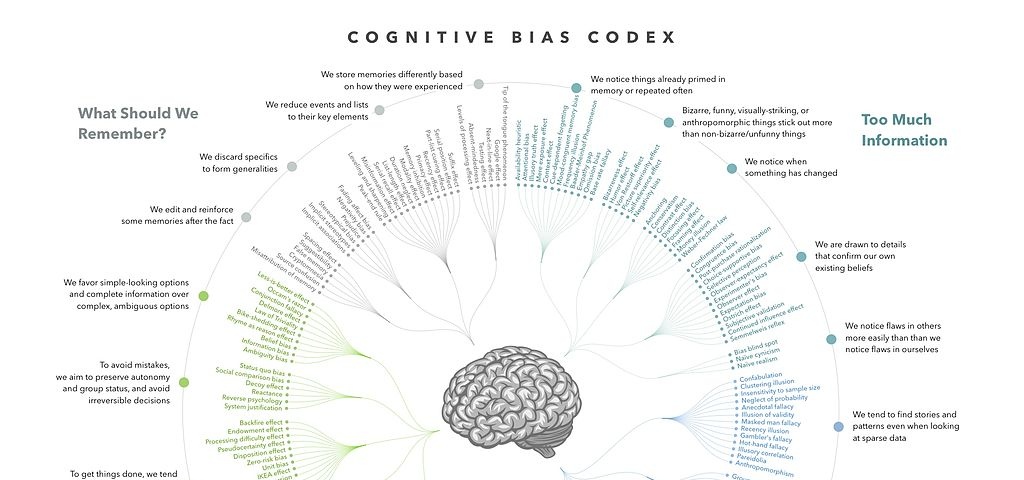

Ниже представлен перевод статьи Cognitive bias cheat sheet, автор Buster Benson. Ценность статьи в том, что она дает понятную классификацию когнитивных искажений исходя из психической проблемы, которую пытается решить то или иное искажение. Взгляд с точки зрения задачи помогает понять пользу и механизм действия этих искажений, проще осознать его применимость к вашему продукту, к вашим CJM. Список был дополнен русскими описаниями каждого из когнитивных эффектов. Им довольно удобно оперировать, чтобы получить необходимое и, в некоторой степени достаточное, представление о всевозможных эффектах для того, чтобы начать знакомство с данной темой.

Я провел много лет, апеллируя к Списку когнитивных искажений (материал из Википедии) всякий раз, когда у меня появлялась догадка, что определенный тип взглядов — это официальное искажение, но я не мог вспомнить название и детали. Это была неоценимая ссылка, которая помогла мне определить скрытые недостатки в моих собственных взглядах. Никакой материал из тех, что мне встречались, не были одновременно столь исчерпывающим, и столь краткими.

Однако, если честно, страница Wikipedia — что-то вроде запутанного беспорядка. Несмотря на попытку усвоить информацию с этой страницы много раз за эти годы, я очень мало запомнил. Я часто просматриваю список и понимаю, что я не в состоянии найти искажение; я ищу, затем быстро забываю то, что я изучил. Я думаю, что это связано с тем, как страница органично развивалась на протяжении многих лет. Сегодня, это 175 искажений, сгруппированных в расплывчатые категории (Искажения, связанные с поведением и принятием решений; Социально обусловленные искажения; Искажения, связанные с ошибками памяти и т.д.), которые на самом деле не кажутся взаимоисключающими, а затем их перечисление их в алфавитном порядке по категориям. В статье есть дубликаты, и много схожих искажений с разными именами, разбросанных кое-как.

Я думаю, что это связано с тем, как страница органично развивалась на протяжении многих лет. Сегодня, это 175 искажений, сгруппированных в расплывчатые категории (Искажения, связанные с поведением и принятием решений; Социально обусловленные искажения; Искажения, связанные с ошибками памяти и т.д.), которые на самом деле не кажутся взаимоисключающими, а затем их перечисление их в алфавитном порядке по категориям. В статье есть дубликаты, и много схожих искажений с разными именами, разбросанных кое-как.

Я выделил немного времени в течение последних четырех недель (я в отпуске по уходу за ребенком), чтобы попытаться более глубоко усвоить и понять этот список, и попытаться придумать более простую, более четкую организационную структуру, чтобы разложить все по полочкам. Более детальное изучение различных искажений дало мне пищу для размышлений, пока я убаюкивал маленького Луи.

Я начал с чернового списка из 175 искажений и добавил их всех в электронную таблицу затем просмотрел еще раз для удаления дубликатов и сгруппировал схожие искажения (такие как эффект причудливости и эффект юмора) или дополняющие друг друга (как искажение, вызванное оптимизмом и искажение, вызванное пессимизмом). Список свелся приблизительно к 20 уникальным необъективным умственным стратегиям, которые мы используем по очень специфическим причинам.

Список свелся приблизительно к 20 уникальным необъективным умственным стратегиям, которые мы используем по очень специфическим причинам.

Я сделал несколько различных попыток сгруппировать эти 20 или около того на более высоком уровне, и в конце концов остановился на группировке по общей психической проблеме, которую они пытались решить. Каждое когнитивное искажение, в первую очередь, находится там для того, чтобы сохранить время или энергию нашего мозга. Если вы посмотрите на них с точки зрения задачи, которую они пытаются решить, становится намного легче понять, почему они существуют, насколько они полезны и компромиссные решения (в результате ментальных ошибок), которые они представляют.

Четыре проблемы, которые искажения помогают нам решить:

Информационная перегрузка, недостаток смысла, необходимость действовать быстро, и как узнать, что необходимо запомнить для последующего использования.

Проблема 1: Слишком много информации.

Существует слишком много информации в мире, у нас нет иного выбора, кроме как отфильтровать почти всю информацию. Наш мозг использует несколько простых трюков, чтобы выбрать частицы информации, которые скорее всего, будут полезны в некотором смысле.

Наш мозг использует несколько простых трюков, чтобы выбрать частицы информации, которые скорее всего, будут полезны в некотором смысле.

- Мы замечаем вещи, которые уже заложенных в памяти или часто повторяются. Это простое правило, что наш мозг более склонен замечать вещи, которые связаны с материалом, который недавно был загружен в память.

- Attentional bias. Искажение, вызванное вниманием.Если что-то постоянно находится в фокусе вашего внимания, то это влияет на вашу способность к адекватной оценке. Частный пример: игнорировать некоторые варианты при оценке вероятностей (фанатик-националист в первую очередь обращает внимание на национальность и упускает, что носитель «неприятной» ему национальности может быть достойным человеком).

- Availability heuristic. Эвристика доступности.Склонность считать «более вероятным» то, что проще вспомнить или снабдить примером из памяти; отклонение в сторону более яркого, необычного или эмоционально заряженного.

- Illusory truth effect.

Каскад доступной информации (эффект мнимой правды).Самоусиливающийся процесс, в ходе которого коллективная вера во что-то становится всё более убедительной за счёт нарастающего публичного повторения («повторяйте это долго и это станет правдой»).

Каскад доступной информации (эффект мнимой правды).Самоусиливающийся процесс, в ходе которого коллективная вера во что-то становится всё более убедительной за счёт нарастающего публичного повторения («повторяйте это долго и это станет правдой»). - Mere exposure effect. Эффект знакомства с объектом.Склонность иметь чрезмерное расположение к объекту лишь из-за знакомства с ним.

- Context effect. Эффект контекста.Эффект: без контекстуальных «зацепок», сигналов, знаков вспоминать информацию и вообще вести мыслительную деятельность — сложнее. «Работать в офисе проще, чем дома».

- Cue-dependent forgetting, Mood-congruent memory bias. Отклонение в сторону соответствия эмоциям.Эмоционально заряженный материал лучше запоминается в соответствующем ему эмоциональном состоянии

- Frequency illusion, Baader-Meinhof Phenomenon. Иллюзия частотности (феномен Баадера-Майнхоф).Услышав или узнав что-то, вы очень скоро снова наталкиваетесь на эту же информацию, которая была в общем доступе и раньше, однако до вас не доходила.

И кажется, что частотность её появления повысилась.

И кажется, что частотность её появления повысилась. - Empathy gap. Эмоциональный разрыв.Склонность недооценивать влияние или силу чувств (применительно к себе или другим людям).

- Omission bias. Недооценка бездействия.Склонность осуждать вредоносные действия сильнее, чем настолько же вредоносное бездействие.

- Base rate fallacy. Ошибка базовой доли (ошибка, связанная с частными примерами).Ошибочная оценка конкретной информации из «частного случая» как верной, при том что более общая информация (например, статистика) подталкивает к противоположным выводам. Пример: ваши подозрения, что этот незнакомый человек со зловещим лицом — бандит, хотя не-бандитов зловещего вида — больше, чем бандитов).

- Причудливые / смешные / визуально поразительные / антропоморфные вещи запоминаются больше, чем не-причудливые / не-остроумные вещи. Наш мозг, склонен повышать значимость вещей, которые являются необычными и удивительными. В качестве альтернативы, мы склонны пропускать информацию, которая по нашему мнению, является обычной или ожидаемой.

- Bizarreness effect,. Эффект причудливости.Причудливое запоминается лучше, чем обычное.

- Humor effect. Эффект юмора.Смешные вещи проще запомнить, чем несмешные.

- Von Restorff effect. Эффект Ресторфф (эффект изоляции).Объект, выделяющийся из ряда схожих объектов, запоминается лучше других.

- Picture superiority effect. Эффект превосходства картинки. Концепт понятнее для людей, если объяснен в картинках, а не только письменными словами.

- Self-relevance effect. Эффект собственной значимости. Воспоминания о себе лучше удерживаются в памяти, чем аналогичная информация о других.

- Negativity bias. Искажение отрицательности. Психологический феномен: плохие воспоминания запоминаются и вспоминаются лучше, чем хорошие

- Мы замечаем, когда что-то изменилось. И мы обычно склонны взвешивать смысл нового значения исходя из направления, в котором изменение произошло (положительное или отрицательное) больше, чем переоценивать новое значение, как если бы оно было представлено в одиночку.

Это же относится и к тому, когда мы сравниваем две схожие вещи.

Это же относится и к тому, когда мы сравниваем две схожие вещи.- Anchoring, Эффект привязки (эффект якоря). Склонность смещать оценку неизвестного значения в сторону «якоря» — числа, попавшего в сознание перед принятием решения.

- Contrast effect. Эффект контраста. Увеличение или уменьшение воспринимаемого значения из-за сравнения с ранее воспринятым контрастирующим значением (на картине серый кажется рыжеватым или голубоватым из-за соседних красок; цена — более высокой или низкой из-за цены в соседнем магазине).

- Focusing effect. Эффект фокусировки.Ошибка в предсказаниях, возникающая, когда люди уделяют слишком много внимания какому-то одному аспекту явления.

- Money illusion Денежная иллюзии.Склонность смотреть на номинальную стоимость денег, а не на их реальную покупательную способность.

- Framing effect. Эффект обрамления (эффект воздействия рамок). Из информации делаются различные выводы в зависимости от того, как она представлена («потерю можно представить приобретением и наоборот»).

- Weber–Fechner law. Закон Вебера — Фехнера эмпирический.Психофизиологический закон, заключающийся в том, что интенсивность ощущения прямо пропорциональна логарифму интенсивности раздражителя.

- Conservatism. Консерватизм (коррекция мнения). Склонность при предъявлении новых свидетельств изменять мнение недостаточно («недосчитывать» правильную вероятность или проделывать это медленнее, чем если бы использовалась теорема Байеса).

- Distinction bias. Систематическая ошибка различения. Склонность воспринимать два варианта как более различные при одновременной оценке — сравнительно с отдельной оценкой каждого из них.

- Нас привлекают детали, которые подтверждают наши собственные существующие убеждения. Это важно. Как следствие: мы склонны игнорировать детали, которые противоречат нашим собственным убеждениям.

- Confirmation bias. Предвзятость подтверждения.

Cклонность искать или интерпретировать информацию таким образом, чтобы подтвердить имеющиеся мнения.

- Congruence bias. Систематическая ошибка согласованности. Склонность проверять гипотезу только прямым её тестированием, пренебрегать косвенным тестированием и проверкой альтернативных гипотез.

- Post-purchase rationalization. Рационализация после покупки. Склонность убеждать себя рациональными аргументами, что покупка стоила своих денег.

- Choice-supportive bias, Искажение, поддерживающее выбор. Склонность помнить свои выборы как более правильные, чем они были в действительности.

- Selective perception. Выборочное восприятие. Восприятие, искаженное ожиданиями.

- Observer-expectancy effect. Эффект наблюдательского ожидания.Склонность исследователя ожидать определённого результата и бессознательно манипулировать ходом эксперимента (или неправильно интерпретировать его итоги), чтобы обнаружить именно этот результат

- Expectation bias. Искажение из-за ожиданий.

Склонность предпочитать данные, подтверждающие ожидания экспериментатора, данным, которые опровергают ожидания.

- Observer effect. Эффект наблюдательского ожидания. Склонность исследователя ожидать определённого результата и бессознательно манипулировать ходом эксперимента (или неправильно интерпретировать его итоги), чтобы обнаружить именно этот результат

- Ostrich effect. Эффект страуса. Эффект: игнорирование очевидно существующей негативной ситуации

- Subjective validation. Субъективное подтверждение (субъективное придание значимости). Субъект считает что-либо правдивым/существенным, если ему важно, чтобы это было правдивым/существенным. Касается утверждений, взаимосвязей и т.д.

- Continued influence effect. Подтверждения.Cклонность искать или интерпретировать информацию таким образом, чтобы подтвердить имеющиеся мнения.

- Semmelweis reflex. Эффект Семмелвайса. Склонность отвергать новые факты или знания, если они противоречат устоявшимся догмам

- Confirmation bias. Предвзятость подтверждения.

Cклонность искать или интерпретировать информацию таким образом, чтобы подтвердить имеющиеся мнения.

- Мы легко замечаем недостатки в других, чем в себе.

Да, прежде чем вы увидите эту статью целиком в виде списка причуд, которые компрометируют то, как другие мыслят, осознайте, что вы — тоже субъект этих искажений.

Да, прежде чем вы увидите эту статью целиком в виде списка причуд, которые компрометируют то, как другие мыслят, осознайте, что вы — тоже субъект этих искажений.- Bias blind spot. Мертвая зона когнитивных искажений (слепое пятно в отношении когнитивных искажений). Склонность считать, что другие подвержены большему числу искажений, чем ты.

- Naïve cynicism. Простодушный цинизм. Склонность ожидать от других больше эгоцентрических искажений, чем от себя

- Naïve realism. Наивный реализм. Эпистемологическая позиция в философии и в обыденном сознании, согласно которой реально всё, что нормальный человек воспринимает в нормальных условиях и описывает общепринятым и соответствующим фактам языком

Проблема 2: Недостаток смысла.

Мир очень сбивает с толку, и мы в конечном итоге видим только его крошечный кусочек, но нам нужен какой-то смысл для того, чтобы выжить. После того, как поступает уменьшенный поток информации, мы соединяем точки, заполняем пробелы материалом, который, как нам кажется, мы уже знаем и обновляем наши ментальные модели мира.

- Мы находим истории и закономерности даже в разреженных данных. Как только мы получаем крошечный кусочек информации о мире, а также отфильтровываем почти все остальное, мы никогда не можем позволить себе такую роскошь, как иметь полную историю. Это — то, как наш мозг восстанавливает мир, чтобы чувствовать его законченным в наших головах.

- Confabulation. Ложная память. Способность считать сильно искаженные воспоминания правдивыми, искренне выдавать выдумку, фантазию за реальное воспоминание.

- Clustering illusion. Иллюзия кластеризации. Склонность видеть паттерны и закономерности там, где их нет.

- Insensitivity to sample size. Ошибка из-за размера выборки. Склонность не учитывать, что вариативность при малых размерах выборки — значительнее, чем при больших

- Neglect of probability. Отрицание вероятности. Склонность пренебрегать одной или несколькими вероятностями при принятии решения в условиях неопределенности.

- Anecdotal fallacy.

Анекдотическая ошибка.

Вы используете личный опыт или изолированный пример вместо звукового аргумента или убедительного свидетельства.

Для людей часто намного легче верить чьим-то свидетельским показаниям в противоположность пониманию сложных данных и изменения через континуум. Количественные научные меры почти всегда более точны, чем личное восприятие и события, но наше предпочтение состоит в том, чтобы верить материальным вещам и/или словам кого-то, кому мы доверяем, чем ‘абстрактной’ статистической действительности.

Анекдотическая ошибка.

Вы используете личный опыт или изолированный пример вместо звукового аргумента или убедительного свидетельства.

Для людей часто намного легче верить чьим-то свидетельским показаниям в противоположность пониманию сложных данных и изменения через континуум. Количественные научные меры почти всегда более точны, чем личное восприятие и события, но наше предпочтение состоит в том, чтобы верить материальным вещам и/или словам кого-то, кому мы доверяем, чем ‘абстрактной’ статистической действительности. - Illusion of validity. Иллюзия обоснованности. Вера, что собранная в дальнейшем информация позволит делать более точные прогнозы (на самом деле — нет, не позволит).

- Masked man fallacy. Ошибка про человека в маске. Ошибка в формальной логике, при которой замена обозначения на идентичное в верном утверждении приводит к неверному.

- Recency illusion. Иллюзия новизны.

Восприятие слова или языкового правила как нового, хотя в действительности оно используется давно.

- Gambler’s fallacy. Ошибка игрока. Склонность думать, что прошлые события повлияют на будущие вероятности («чем больше раз подряд выбрасываешь решку, тем выше вероятность «орла»)

- Hot-hand fallacy. Заблуждение «счастливой руки». Склонность считать, что тот, кому повезло, и при следующих попытках будет более везучим.

- Illusory correlation. Иллюзорная корреляция. Ошибочная вера во взаимосвязь определённых переменных

- Pareidolia. Парейдолия. Разновидность зрительных/слуховых иллюзий: появление образов, основой которых являют детали реального объекта. Пример — фигуры людей и животных в облаках, лицо человека на поверхности Марса и т.д.

- Anthropomorphism. Антропоморфизм. Перенесение человеческого образа и его свойств на неодушевлённые предметы, на одушевлённых существ, на явления и силы природы, на сверхъестественных существ, на абстрактные понятия и др.

- Мы заполняем характеристики из стереотипов, обобщений и предшествующих историй каждый раз, когда появляются новые конкретные случаи или пробелы в информации.

Когда у нас есть частичная информация об определенной вещи, которая принадлежит группе вещей, с которыми мы достаточно хорошо знакомы, наш мозг не имеет никаких проблем, заполняя пробелы лучшими догадками или другими данными из проверенных источников. Удобно то, что тогда мы забываем, какие части были реальными, а какие были заполнены.

Когда у нас есть частичная информация об определенной вещи, которая принадлежит группе вещей, с которыми мы достаточно хорошо знакомы, наш мозг не имеет никаких проблем, заполняя пробелы лучшими догадками или другими данными из проверенных источников. Удобно то, что тогда мы забываем, какие части были реальными, а какие были заполнены.- Group attribution error. Ошибка коллективной атрибуции. Вера в то, что свойства участника коллектива совпадают с общими коллективными свойствами. Вариант: вера в то, что решение группы отражает предпочтения всех участников группы (даже если есть свидетельства обратного).

- Ultimate attribution error. Предельная ошибка атрибуции. Родственница фундаментальной ошибки атрибуции: тот же принцип (хорошее — моя заслуга, плохое — вина обстоятельств) распространяется на всю «свою» группу. Соответственно другие группы в плохом виноваты сами, а успехи их вызваны обстоятельствами и везением.

- Stereotyping. Стереотипизация.

Ожидание определенных свойств от человека из-за его принадлежности к какой-либо группе, при том, что о самом человеке значимых данных нет.

- Essentialism. Эссенциализм. теоретическая и философская установка, характеризующаяся приписыванием некоторой сущности неизменного набора качеств и свойств, «концепция, предполагающая, что у вещей есть некая глубинная реальность, истинная природа, которую нельзя узреть напрямую, и что для нас важна именно эта скрытая сущность» Наука удовольствия. Почему мы любим то, что любим

- Functional fixedness. Функциональная закрепленность. Склонность использовать предмет лишь таким образом, каким его традиционно используют.

- Moral credential effect. Эффект морального доверия. Эффект: человек, которого считают объективным, с большей вероятностью проявит необъективность («сам поверит в то, что он всегда прав»).

- Just-world hypothesis. Гипотеза «справедливого мира». Склонность верить: мир — справедлив, а жертвы — «сами виноваты».

- Argument from fallacy. Ошибочность аргумента. Формальная ошибка анализа аргумента и вывода, который также содержит ошибку, ее заключение должно быть ложным.

- Authority bias. Влияние авторитета.Тенденция приписать большую точность мнению авторитетной фигуры (не связанный с его содержанием) и быть под большим влиянием этого мнения

- Automation bias. Эффект автоматизации. Тенденция зависеть чрезмерно от автоматизированных систем, которые могут привести к ошибочной автоматизированной информации, отвергающей правильные решения.

- Bandwagon effect. Эффект повального увлечения. Cклонность делать что-то или верить во что-то лишь потому, что многие люди так делают или верят.

- Placebo effect. Эффект плацебо. Основывается на целенаправленном или неосознанном внушении врачом или экспериментатором, что определенный фактор (препарат, способ действий) должен привести к желаемому результату

- Мы представляем себе вещи и людей, с которыми мы знакомы или любим, лучше, чем вещи и людей, с которыми мы не знакомы или не любим. Как сказано выше, заполненные фрагменты восприятия в целом также включают построенные предположения о качестве и ценности вещи, на которую мы смотрим.

- Halo effect. Эффект ореола (гало-эффект). Эффект: общее хорошее или плохое впечатление о чем-либо (явлении, человеке, вещи) распространяется на восприятие частных особенностей.

- In-group bias. Искажение в пользу своей группы. Склонность отдавать предпочтение тем, кого вы считаете «своими», участниками вашей группы.

- Out-group homogeneity bias. Ошибочная оценка единообразия в группе. Склонность воспринимать участников своего коллектива как относительно более разнообразных, чем участники других коллективов.

- Cross-race effect. Эффект встречи разных рас. Эффект: представителей другой расы сложнее различать, чем представителей своей.

- Cheerleader effect. Эффект чирлидера. Ошибка в оценке привлекательности: в группе люди кажутся более привлекательными, чем поодиночке.

- Well-traveled road effect. Эффект хорошо знакомой дороги. Эффект: незнакомые маршруты кажутся более времязатратными.

- Not invented here. Синдром неприятия чужой разработки. позиция в социальной, корпоративной или организационной культурах, при которой избегается использование или покупка уже существующих разработок, исследований, стандартов или знаний, из-за их внешних происхождения и затрат.

- Reactive devaluation. Реактивное обесценивание. Эффект: предложение обесценивается, если исходит от противника или другого неприятного субъекта.

- Positivity effect. Эффект положительности (эффект позитивности). Склонность объяснять успехи людей, которые вам нравятся, их личными качествами, а провалы — неудачными обстоятельствами.

- Мы упрощаем вероятности и числа, чтобы сделать их легче для обдумывания. Наше подсознание ужасно разбирается в математике и в целом генерирует неправильные данные о вероятности происходящего, если какие-либо данные отсутствуют.

- Mental accounting. Ментальный учет. Попытки описать процесс, посредством чего люди кодируют, категоризируют и оценивают экономические результаты

- Normalcy bias. Искажение нормальности (в смысле «нормального распределения данных»). Отказ человека готовиться к несчастью, которое не случалось с ним раньше, или реагировать на него.

- Appeal to probability fallacy. Является логической ошибкой объяснения чего-то само собой разумеющимся, потому что это, вероятно, имело бы место (или могло бы возможно иметь место).

- Murphy’s Law. Закон Мерфи. Если есть вероятность того, что какая-нибудь неприятность может случиться, то она обязательно произойдёт

- Subadditivity effect. Эффект субаддитивности. Эффект: вероятность целого оценивается как меньшая, чем сумма вероятностей его частей.

- Survivorship bias. Систематическая ошибка выживаемости. Аналитическая ошибка: при расчете по данным одной группы («выжившие»), данные по другой («погибшие») не учитываются, так как их просто нет в наличии.

- Zero sum bias. Эвристика нулевой суммы. Склонность уравновешивать возможные потери и приобретения, видеть в ситуации «игру с нулевой суммой». Например, стремиться выиграть, чтобы не оказаться проигравшим, забывая о возможности взаимовыгодного исхода.

- Denomination effect. Эффект деноминации. Склонность людей с большей вероятностью тратить мелкие, «размененные», деньги, чем крупные купюры.

- Magic number 7+-2. Магическое число семь плюс-минус два.Закономерность, согласно которой кратковременная человеческая память, как правило, не может запомнить и повторить более 7 ± 2 элементов.

- Мы думаем, что знаем, что думают другие. В некоторых случаях это означает, что мы предполагаем, что они знают, то что знаем мы, в других случаях, мы предполагаем, что они думают о нас так столько же, сколько мы думаем о себе. В основном это просто случай того, что мы моделируем их собственный ум как свой (или в некоторых случаях как значительно менее сложный ум, чем собственный).

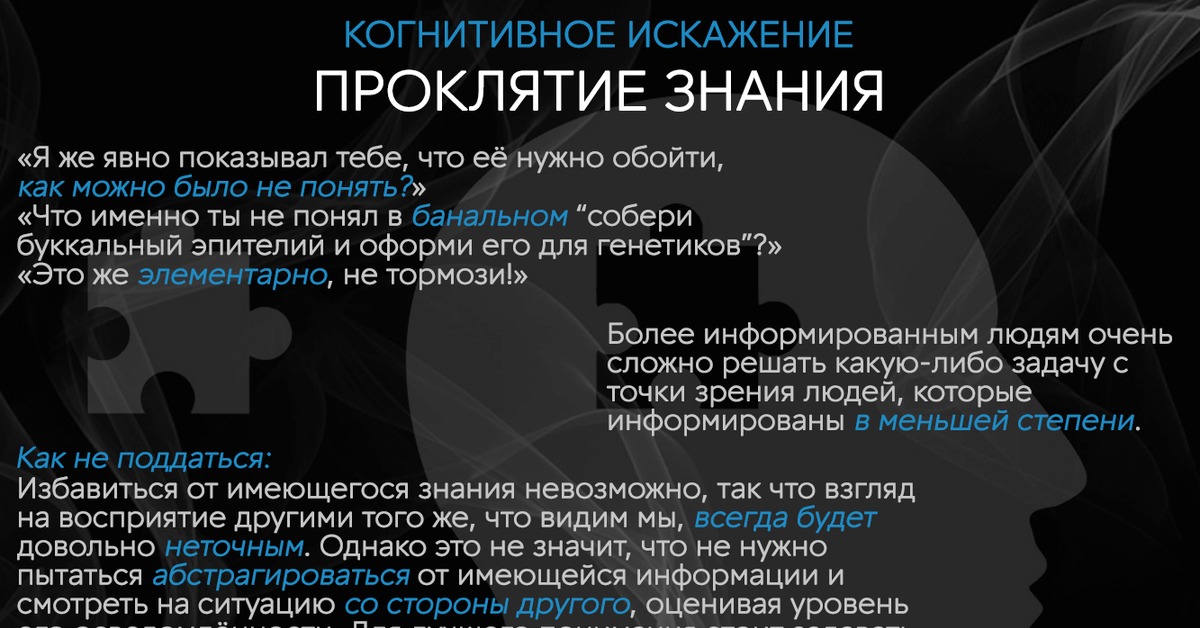

- Curse of knowledge. Проклятие знания. Эффект: хорошо знакомым с проблемой людям очень сложно рассматривать её с точки зрения менее информированных людей («учитель не может подобрать понятные объяснения сложной темы для учеников»).

- Illusion of transparency. Иллюзия прозрачности. Склонность переоценивать и свою способность понимать других, и способность других понимать тебя.

- Spotlight effect. Эффект прожектора. психологический эффект, заключающийся в тенденции к переоценке того, насколько действия человека и его внешний вид заметны для окружающих.

- Illusion of external agency. Иллюзия постороннего участия. Склонность объяснять свои предпочтения влиянием внешних сил, которые «положительны» (эффективны, проницательны, дружественны).

- Illusion of asymmetric insight. Иллюзия асимметричной проницательности.Склонность считать, что ты знаешь людей лучше, чем они знают тебя.

- Extrinsic incentive error. Отклонение в сторону внешних стимулов. (условное)Исключение из ряда фундаментальных ошибок атрибуции: другие люди видятся как обладатели внешней (например, денежной) мотивации, а себя человек рассматривает как внутренне мотивированного.

- Мы проектируем наше текущее мышление и предположения на прошлое и будущее. Преувеличенные тем фактом, что мы не очень хорошо представляем себе, как быстро или медленно вещи будут происходить или изменятся с течением времени.

- Hindsight bias. Ретроспективное искажение. Эффект «я так и знал!»: прошлое кажется более предсказуемым из настоящего. «Знание задним числом»

- Outcome bias. Отклонение в сторону результата. Тенденция судить о решениях по их окончательным результатам, вместо того чтобы оценивать качество решений по обстоятельствам того момента времени, когда они были приняты («Победителей не судят»).

- Moral luck. Случайная добродетель (отклонение в сторону результата). Склонность оценивать добродетельность поступка (ругать или хвалить) по результатам, к которым этот поступок привел — как будто совершивший поступок заранее знал последствия или мог их контролировать (на самом деле всё часто определяется вмешательством случайности)

- Declinism.

- Telescoping effect. Эффект телескопа. Недавние события кажутся более отдалёнными, а более давние события — более близкими во времени.

- Rosy retrospection. Приукрашивание прошлого. Эффект: прошлое кажется лучшим, чем оно было на самом деле.

- Impact bias. Переоценка воздействия. Склонность переоценивать длительность или интенсивность будущих переживаний, вызванных неким событием.

- Pessimism bias. Искажение, вызванное пессимизмом. Склонность постоянно переоценивать вероятность негативного исхода.

- Planning fallacy. Ошибка планирования. Склонность недооценивать время выполнения задачи

- Time-saving bias. Ошибка сэкономленного времени. Склонность неправильно подсчитывать время, которое высвободится/потратится при ускорении/замедлении.

- Pro-innovation bias. Искажение изобретателя. Склонность слишком высоко оценивать полезность изобретения или нововведения, не замечать его недостатков, верить в его быстрое внедрение

- Projection bias. Проективное искажение (Искажение в связи с проекцией). Склонность бессознательно предполагать, что у других людей — такие же мысли, ценности и позиции, что и у тебя. И думать, что в будущем они у тебя не изменятся.

- Restraint bias. Искажение сдержанности. Склонность переоценивать свою способность контролировать импульсивное поведение.

- Self-consistency bias. Кажущееся постоянство. Склонность неправильно помнить чьи-либо прошлые позиции/поведение, сближая их с теперешними позициями/поведением

А теперь ненадолго прервемся, чтобы мозг от переизбытка информации не начал выкидывать свои хитрые трюки. Продолжение — перевод и расшифровку проблем 3 и 4 — читайте в в следующем посте.

Когнитивные искажения морочат нам голову | Наука | ИноСМИ

Я смотрю на фотографию самого себя на 20 лет старше, чем сейчас. Нет, это не сумеречная зона, скорее я пытаюсь избавиться от уклона в настоящее — тенденции человека к более тщательному взвешиванию того из двух моментов будущего, который более приближен к настоящему. Многие научные исследования показали, что данная тенденция — известная также как гиперболическое дисконтирование — носит стабильный и устойчивый характер.

По большей части акцент делается на деньгах. Когда людей спрашивают, предпочтут они получить, скажем, 150 долларов сегодня или 180 долларов через месяц, большинство выберет первый вариант. А на вопрос, выберут ли они 150 долларов через год или 180 долларов через 13 месяцев, большинство готовы подождать месяц ради 30 долларов сверху.

Разумеется, феномен уклона в настоящее проявляется не только в экспериментах, но и в реальном мире. В Соединенных Штатах, например, люди откладывают крайне мало денег к моменту выхода на пенсию — даже если зарабатывают достаточно, чтобы не тратить всю зарплату на текущие расходы, и даже если работают в одной из таких компаний, которые вкладывают в пенсионный план дополнительные средства.

Такое положение дел заставило ученого по имени Хэл Хершфилд поэкспериментировать с фотографиями. Хершфилд — профессор маркетинга Калифорнийского университете в Лос-Анджелесе, чьи исследования начинаются с идеи об отсутствии связи между нами сегодня и в будущем. В результате чего, как он объяснил в одной из статей 2011 года, «откладывать деньги — все равно что выбирать между тем, чтобы потратить их сегодня или отдать незнакомому человеку много лет спустя». В статье описана попытка Хершфилда и нескольких его коллег изменить подобный образ мышления. Они просили студентов в течение минуты смотреть на цифровые представления себя в виде аватаров, показывающих, как они будут выглядеть в возрасте 70 лет. Затем студентов спросили, что они станут делать, если вдруг получат тысячу долларов. Студенты, смотревшие в глаза своему старшему «я», ответили, что положат на свой пенсионный счет в среднем 172 доллара, что вдвое больше той суммы, которую назвали члены контрольной группы, готовые выделить лишь около 80 долларов.

Сам я уже немолод — разменял седьмой десяток, если вам интересно — и поэтому Хершфилд предоставил мне возможность увидеть образ не только самого себя после восьмидесяти (со старческими пятнами, непомерно асимметричным лицом и морщинами глубиной с выбоины на дорогах Манхэттена), но и моей дочери спустя десятилетия. Он объяснил, что это должно заставить меня задаться вопросом о том, что я почувствую к концу жизни, если о моих детях никто не позаботится?

Когда люди слышат слово предубеждение, многим, если не большинству, на ум приходят либо расовые предрассудки, либо склонные к тенденциозному освещению новостей информагентства. Уклон в настоящее, напротив, является примером когнитивного искажения — совокупности ошибочных типов мышления, встроенных в человеческий мозг. Коллекция, надо сказать, значительная. Статья Википедии под названием «Список когнитивных искажений» содержит 185 пунктов: от эффекта актера и наблюдателя (тенденция объяснять собственные промахи особенностями ситуации, а неприятности, происходящие с окружающими — негативными качествами их личности) до эффекта Зейгарник (когда незавершенные или прерванные действия запоминаются лучше, чем завершенные).

Некоторые из 185 пунктов сомнительны и даже ненаучны. Эффект IKEA, например, определяется как «тенденция покупателей непропорционально высоко оценивать значимость (ценность) товаров, которые они создают отчасти сами». Но примерно 100 искажений действительно существуют, что было неоднократно доказано, и могут внести в нашу жизнь существенную путаницу.

Заблуждение игрока вселяет в нас абсолютную уверенность в том, что, если пять раз подряд монета выпала решкой, вероятнее всего, в шестой раз она приземлится вверх орлом. На самом же деле, шансы всегда составляют 50 на 50. Оптимистический уклон заставляет нас постоянно недооценивать затраты и продолжительность практически каждого предпринимаемого проекта. Эффект доступности заставляет нас думать, что, скажем, путешествие самолетом опаснее путешествия на автомобиле. С точки зрения нашей памяти и воображения, образы авиакатастроф носят более яркий и драматический характер, а потому доступны нашему сознанию в куда большей степени.

Эффект привязки — тенденция излишне полагаться при принятии решений, оценках или прогнозах на первую предложенную информацию, особенно если она представлена в числовой форме. Именно по этой причине участники переговоров намеренно начинают со слишком низких или слишком высоких цифр, поскольку знают, что те станут «якорем» в контексте последующих сделок. Ярким примером эффекта привязки является эксперимент, в ходе которого участников попросили понаблюдать за колесом рулетки, на котором выпадало либо 10, либо 65, а потом угадать долю африканских стран в ООН. Те, кто видел, что колесо останавливается на 10, называли в среднем 25%, остальные — в районе 45%. (На момент проведения эксперимента правильным ответом было бы 28%.)

Последствия искажений проявляются не только в контексте отдельно взятого человека. В прошлом году президент США Дональд Трамп решил отправить новые войска в Афганистан, совершив тем самым ошибку невозвратных затрат. Он заявил: «Наша страна должна добиться почетного и надежного результата, достойного огромных жертв, что были принесены, особенно в плане человеческих жизней». Подобного рода мышление велит нам сделать выбор в пользу неудачного капиталовложения исключительно из-за тех средств, которые мы уже на нем потеряли; доесть в ресторане неаппетитное блюдо, ведь мы же за него заплатили; вести обреченную на проигрыш войну из-за вложенных в нее человеческих и материальных ресурсов. Подобное мышление можно считать заведомо никудышным.

Если бы мне пришлось выбрать из списка какое-то одно, наиболее распространенное и разрушительное искажение, я бы, наверное, назвал предвзятость подтверждения. Эта тенденция заставляет нас искать доказательства, подтверждающие заранее имевшиеся в нашем сознании концепции, рассматривать факты и идеи, с которыми мы сталкиваемся, в качестве дальнейшего подтверждения и сбрасывать со счетов/игнорировать любое доказательство в пользу какой-либо альтернативной точки зрения. Наиболее беззастенчиво предвзятость подтверждения проявляется в нынешних политических разногласиях, когда каждая из сторон не может допустить, чтобы другая оказалось хоть в чем-то права.

Предвзятость подтверждения проявляется и во многих других обстоятельствах, иногда ее последствия просто ужасны. Процитирую доклад 2005 года о подготовке к войне в Ираке: «При наличии доказательств того, что Ирак не располагает [оружием массового уничтожения], аналитики, как правило, такую информацию не учитывали. Вместо того, чтобы взвешивать доказательства в независимом порядке, аналитики принимали ту информацию, что соответствовала общепринятой теории, а противоречившую ей — отвергали».

Более-менее четко идею когнитивных искажений и эвристики ошибок — методов и общих правил, с помощью которых мы принимаем суждения и делаем прогнозы, — описали в 1970-х Амос Тверски и Даниел Канеман, социологи, чья карьера началась в Израиле, а продолжилась в Соединенных Штатах. Именно они проводили эксперимент «доля африканских стран в ООН». Тверски умер в 1996 году. А Канеман получил Нобелевскую премию 2002 года по экономике за их совместную работу, итоги которой он кратко сформулировал в своем бестселлере 2011 года «Думай медленно, решай быстро». История местами спорного сотрудничества Тверски и Канемана рассказана в прошлогодней книге Майкла Льюиса «Отмененный проект». А более ранняя книга Льюиса под названием «Как математика изменила самую популярную спортивную лигу в мире» была о противостоянии волейбольного менеджера Билли Бина когнитивным искажениям приверженцев старой школы, а именно фундаментальной ошибке атрибуции, когда при оценке чьего-то поведения мы придаем слишком большое значение его личным качествам и недооцениваем внешние факторы, многие из которых измеряются статистикой.

© flickr.com, Kevin HutchinsonМозгДругой ключевой фигурой в этой области является экономист из Чикагского университета Ричард Талер. Одним из искажений, с которым его связывают больше остальных, является эффект владения, завышение ценности покупки сразу после её приобретения. В ходе одного из экспериментов, проведенных Талером, Канеманом и Джеком Кнетчем, половине участников дали кружку и спросили, за сколько они бы ее продали. Средний ответ составил 5,78 доллара. Остальные сказали, что купят ту же кружку в среднем за 2,21 доллара. Что противоречит классической экономической теории: в определенное время среди определенной группы населения товар имеет такую рыночную стоимость, которая не зависит от того, владеет им кто-либо или нет. В 2017 году Талер получил Нобелевскую премию по экономике.

Большинство книг и статей о когнитивных искажениях, как правило, ближе к концу, содержат фразу, похожую на мысль из книги «Думая медленно, решай быстро»: «Вопрос, который чаще всего задают о когнитивных иллюзиях, заключается в том, можно ли их преодолеть. Идейный посыл… неутешителен».

Канеман и другие проводят аналогию, основанную на понимании иллюзии Мюллера-Лайера, возникающей при наблюдении отрезков, обрамленных стрелками. Заключается она в том, что отрезок, обрамленный «остриями», кажется короче отрезка, обрамленного «хвостиками», на деле же длина обоих одинакова. Принципиальный момент: даже измерив линии и обнаружив, что они равны, а также выслушав объяснение неврологической подоплеки иллюзии, мы по-прежнему считаем одну линию короче другой.

Как минимум в контексте данной оптической иллюзии наш медлительный, аналитический ум — то, что Канеман называет «Системой 2», — распознаст подвох Мюллера-Лайера и убедит себя не доверять восприятию «Системы 1», которая срабатывает автоматически и очень быстро. Но в реальном мире все не так просто, ведь мы имеем дело не с отрезками, а с людьми и ситуациями. «К сожалению, эта разумная процедура вряд ли осуществится там, где она нужнее всего, — пишет Канеман. — Всем бы хотелось, чтобы предупреждающий звонок громко звенел каждый раз, как только нам грозит ошибка, но такого звонка нет».

Поскольку искажения кажутся столь укоренившимися и неизменными, бóльшая часть внимания, уделяемого их противодействию, касалась не самих проблемных мыслей, суждений или прогнозов, а изменения поведения в форме стимулов и побуждений. Например, хотя уклон в настоящее до сих пор представлялся труднопреодолимым, работодатели смогли подтолкнуть сотрудников к выделению средств на пенсионные планы, сделав экономию параметром по умолчанию; активные усилия должны предприниматься, чтобы не участвовать. То есть лень и бездействие могут быть сильнее предубеждений. Процедура также может быть организована таким образом, чтобы отговорить или помешать людям руководствоваться в своих действиях тенденциозностью. Известный пример: чек-листы для врачей и медсестер, представленные Атулом Гаванде в книге «Чек-лист. Как избежать глупых ошибок, ведущих к фатальным последствиям».

Действительно ли, однако, от предубеждений невозможно ни избавиться, ни значительно их смягчить? Кое-какие исследования дали предварительный ответ на этот вопрос. Эксперименты основаны на реакциях и ответах произвольно выбранных субъектов, многие из которых являются студентами, то есть их больше волнуют те 20 долларов, что им заплатят за участие, а не изменение или изучение поведения и мышления. Но что если человек, подвергающийся мероприятиям по избавлению от предрассудков, настроен решительно и сам заявил о желании участвовать? Иными словами, что если бы речь шла обо мне?

Естественно, я написал Канеману, который в свои 84 года все еще работает в Школе общественных и международных отношений имени Вудро Вильсона при Принстонском университете, но большую часть времени проводит на Манхэттене. Он быстро ответил мне, согласившись встретиться. «Я должен, — сказал он, — хотя бы попытаться отговорить вас от задуманного».

Я встретился с профессором в кафе «Хлеб насущный» на нижнем Манхэттене. Он оказался высоким, учтивым и приветливым человеком с ярко выраженным акцентом и кривой улыбкой. За яблочным пирогом и чаем с молоком он сказал мне: «Темперамент имеет прямое отношение к моей позиции. Пессимистичнее меня вы не найдете никого».

© AP Photo, Heather de Rivera/McCarroll Lab/Harvard via APНейроны мозгаВ этом контексте его пессимизм связан, во-первых, с невозможностью внесения каких-либо изменений в «Систему 1», ту часть нашего мозга, которая отличается быстротой мысли и выносит ошибочные суждения, эквивалентные иллюзии Мюллера-Лайера. «Я вижу неравные линии, — сказал он. — Цель состоит в том, чтобы не доверять тому, что, как мне кажется, я вижу. Понять, что глазам верить не стóит». Это реально в случае с оптической иллюзией, отметил он, но чрезвычайно сложно в контексте реальных когнитивных искажений.

По словам Канемана, эффективнее всего проверить их можно извне: другие способны воспринимать наши ошибки легче нас самих. И «системы, отличающиеся медленным мышлением», как он выразился, могут определять стратегии, включающие контроль за отдельными решениями и прогнозами. Здесь также могут потребоваться чек-листы и «премортемы» — идея и термин, придуманные когнитивным психологом Гэри Кляйном. Премортем есть попытка противостоять оптимистическому уклону, когда от членов команды требуют представить, что проект закончится неудачно, и написать об этом пару предложений. Это упражнение, как оказалось, помогает людям думать наперед.

«Моя позиция такова: ничто из этого не имеет влияния на „Систему 1″, — подчеркнул Канеман. — Вы не можете улучшить интуицию. Возможно, пройдя долгосрочное обучение, проведя множество разговоров и подвергнувшись воздействию поведенческой экономики, вы сможете обосновать первоначальный стимул и обязать „Систему 2″ к соблюдению правил. К сожалению, для большинства людей в пылу споров и дискуссий правила улетучиваются как дым».

Во время нашего общения с Канеманом он параллельно переписывался с Ричардом Нисбеттом, профессором социальной психологии из Мичиганского университета. Они поддерживали профессиональный отношения на протяжении десятилетий. Нисбетт сыграл важную роль в распространении мыслей Канемана и Тверски в книге 1980 года под названием «Человеческое умозаключение: стратегии и недостатки социальных суждений». Канеман, в свою очередь, в книге «Думай медленно, решай быстро» описывает раннюю статью Нисбетта, в которой демонстрировалось нежелание субъектов верить статистическим и другим общепринятым данным, а также тенденция основывать свои суждения на отдельных примерах и наглядных случаях из жизни. (Это искажение известно как игнорирование базовой информации.)

Project SyndicateAftonbladetBBCMediumОднако с течением времени Нисбетт в своих исследованиях и размышлениях стал подчеркивать возможность обучения людей преодолевать или избегать ряд ловушек, включая игнорирование базовой информации, фундаментальную ошибку атрибуции и ошибку невозвратных затрат. Он написал Канеману электронное письмо отчасти потому, что работал над мемуарами и хотел обсудить состоявшийся на недавней конференции разговор с Канеманом и Тверски. У Нисбетта создалось впечатление, что коллеги рассердились, восприняв все его слова и действия скрытой критикой в свой адрес. Канеман вспомнил тот разговор и ответил: «Да, помнится, мы были (несколько) раздражены вашей работой над простотой обучения статистическим интуитивным представлениям (и гнев чрезвычайно силен)».Когда Нисбетта просят привести пример своего подхода, он обычно упоминает исследование, касающееся бейсбола. Студентам Мичиганского университета звонили под предлогом проведения опроса о спорте и спрашивали, почему в высшей лиге всегда есть несколько баттеров (отбивающих), которые в начале сезона наносят в среднем 450 ударов, но при этом сезон со столь высоким средним показателем не заканчивал никто. Около половины студентов, у которых не было такого предмета как «Введение в статистику», дают неверные ответы вроде «питчеры привыкают к баттерам», «баттеры устают по ходу сезона» и так далее. И примерно половина дает правильный ответ, ссылаясь на закон больших чисел, который гласит, что выпадающие результаты встречаются намного чаще при малом объеме выборки. В течение сезона, по мере увеличения количества выходов к бите, регрессия к среднему значению неизбежна. Когда Нисбетт задает тот же вопрос студентам, которые с курсом статистики знакомы, правильный ответ дают около 70%. Вопреки мнению Канемана, он считает, что подобный результат говорит о возможности включения закона больших чисел в «Систему 2» — а, может, и в «Систему 1», при наличии даже минимальных стимулов.

Второй излюбленный пример Нисбетта заключается в том, что экономисты, усвоившие уроки ошибки невозвратных затрат, часто уходят с плохих фильмов и не доедают невкусные блюда в ресторане.

Я поговорил с Нисбеттом по телефону и спросил о противоречиях с Канеманом. Его голос показался мне немного неуверенным. «Дэнни был, казалось, убежден в тривиальности того, что демонстрировал я, — сказал он. — Ему было ясно одно: обучение безнадежно для любого рода суждений. Но мы тестировали студентов Мичиганского университета в течение четырех лет, и они показывают прекрасные результаты касаемо способности решать проблемы».

В своей книге 2015 года «Мозгоускорители. Как научиться эффективно мыслить, используя приемы из разных наук» Нисбетт пишет следующее: «Благодаря собственным исследованиям процесса обучения людей статистическому мышлению я знаю, что всего нескольких примеров в двух или трех областях достаточно, чтобы улучшить мотивацию людей в условиях бесконечно большого количества событий».

В одном из своих электронных писем к Нисбетту Канеман предположил, что в значительной степени разница между их позициями зависит от темперамента: пессимист против оптимиста. В ответ Нисбетт предложил еще один фактор: «Вы с Амосом специализировались на сложных проблемах, в ходе решения которых приходили к неверным ответам. Я же начал изучать легкие проблемы, в которых вы, ребята, не ошибетесь никогда, а вот обычные люди ошибутся точно… Тогда можно рассмотреть влияние обучения на легкие проблемы, и те оказываются в конечном итоге огромными».

Пример простой проблемы — баттер в начале бейсбольного сезона. Примером трудной является так называемая «проблема Линды», которая легла в основу одной из ранних статей Канемана и Тверски. Говоря простым языком, в ходе эксперимента участникам рассказывали о некой вымышленной женщине по имени Линда, ее идеях о социальной справедливости, учебе в колледже по специальности философия, участии в демонстрациях против использования атомной энергии и так далее. Затем испытуемых спросили, что из следующего более вероятно: а) что Линда кассир в банке или b) что она кассир в банке и активистка феминистского движения. Правильный ответ (a), поскольку выполнение одного условия всегда более вероятно, чем двух сразу. Но из-за ошибки конъюнкции (предположения о том, что несколько определенных условий вероятнее одного общего) и эвристики репрезентативности (наше страстное желание использовать стереотипы) более 80% опрошенных студентов выбрали ответ (b).

Нисбетт справедливо спрашивает, как часто в реальной жизни нам приходится делать суждения, подобные тому, что требуется в «проблеме Линды». Я не могу вспомнить ни одной ситуации из своей жизни. Это такая логическая уловка.

Нисбетт предложил мне пройти онлайн-курс «Мозгоускорители. Критическое мышление в информационный век», в котором он говорит о том, что считает наиболее эффективными навыками и концепциями избавления от склонности к определенным оценкам. После чего мне было предложено ответить на вопросы, которые он задает студентам Мичиганского университета. Так я и сделал.

Курс состоит из восьми уроков с графиками и викторинами, а сам Нисбетт появляется на экране в образе авторитетного, но отзывчивого профессора психологии. Рекомендую всем. Он объясняет эвристику доступности таким образом: «Люди удивляются, что самоубийств происходит больше, чем убийств, а вследствие утопления умирает больше, чем в пожарах. Люди всегда уверены в росте преступности», даже если это не так.

© AP Photo, Andres KudackiПрохожие на улице в МадридеОн обращается к логической ошибочности склонности к предвзятости подтверждения и объясняет, что при проверке считающейся верной гипотезы люди склонны искать подтверждающие ее примеры. Но Нисбетт демонстрирует, что независимо от количества собранных примеров, мы никогда не сможем это утверждение доказать. Правильнее было бы поискать опровержение.

А к проблеме игнорирования базовой информации он подходит с помощью своей собственной стратегии выбора фильмов для просмотра. Его решение никогда не зависит ни от рекламы, ни от конкретных обзоров, ни от импонирующего названия. «Я руководствуюсь базовой информацией и выбираю те книги и фильмы, что рекомендуют люди, которым я доверяю. — говорит он. — Большинство считают себя не такими, как все. Но это не так».

По окончании мною его курса Нисбетт отправил мне опросник, которым они с коллегами пользуются в Мичиганском университете. В нем описано несколько десятков проблем с целью измерения устойчивости субъектов к когнитивным искажениям. Один из примеров представлен здесь.

Из-за предвзятости подтверждения многие неподготовленные люди отвечают (e). Но правильным является ответ (с). Единственное возможное решение в данной ситуации — опровергнуть правило, а единственный способ сделать это — перевернуть карты с изображением буквы «А» (правило будет опровергнуто, если на другой стороне окажется что-то помимо четверки) и числом 7 (правило будет опровергнуто, если на другой стороне окажется буква «А»).

Я правильно понял суть, и Нисбетт, получив мой ответ, написал: «Очень немногие старшекурсники Мичиганского университета справились так же хорошо, как вы, если таковые были вообще. Уверен, что такой же результат показало по крайней мере несколько студентов-психологов второго курса и выше. Ваш результат близок к идеалу».

Однако же я не чувствовал, что благодаря прочтению «Мозгоускорителей» и прохождению онлайн-курса избавился от своих предубеждений. Во-первых, меня не тестировали досрочно, так что я мог считаться относительно беспристрастным. С другой стороны, многие из тестовых вопросов, в том числе приведенный выше, показались мне далекими от ситуаций, с которыми можно столкнуться в повседневной жизни. Кроме того, я был, выражаясь словами Канемана, «подкован». В отличие от старшекурсников Мичиганского университета, я точно знал, почему мне задают эти вопросы, и подошел к их решению соответствующим образом.

Нисбетт, со своей стороны, настаивал на том, что результаты были весьма демонстративны. «Раз вы добиваетесь результатов в контексте тестирования, — сказал он мне, — то добьетесь их и в реальном мире».

Курс Нисбетта и предоставленная Хэлом Хершфилдом возможность встретиться с более старшей версией себя — не единственные методы избавления склонности к определенным оценкам. Нью-йоркский Институт нейролидерства предлагает организациям и частным лицам различные тренинги, вебинары и конференции, обещающие, среди прочего, использовать когнитивную психологию с целью обучения участников противостоять предубеждениям. В этом году двухдневный саммит пройдет в Нью-Йорке; заплатив 2 845 долларов, вы могли бы, к примеру, узнать, «почему наш мозг так слаб в плане мыслей о будущем, и как мы можем улучшить его работу?»

Профессор Уортонской школы бизнеса при Пенсильванском университете Филип Тетлок со своей женой и научным партнером Барбарой Меллерс в течение многих лет изучают так называемое «суперпрогнозирование» и суперпрогнозистов — людей, которым удается обходить когнитивные искажения и предсказывать будущие события с гораздо большей точностью, чем появляющиеся на ТВ ученые так называемые эксперты. В книге Тетлока «Суперпрогнозисты: искусство и наука прогноза» (написанной в соавторстве с Дэном Гарднером), а также посредством коммерческого предприятия Good Judgment, учрежденного им и Меллерс, профессор делится ноу-хау суперпрогнозистов.

Одним из наиболее важных факторов является то, что Тетлок называет «взглядом снаружи». Взгляд изнутри, в свою очередь, является результатом фундаментальной ошибки атрибуции, игнорирования базовой информации и других предубеждений, которые беспрестанно склоняют нас полагаться в своих суждениях и прогнозах не на данные и статистику, а на удачные и яркие примеры. Тетлок объясняет: «На чьей-то свадьбе к вам подходят и спрашивают, сколько, по-вашему, этот брак продлится. Если вы удивлены, поскольку знаете, что новобрачные действительно любят друг друга, то оказались вовлечены во взгляд изнутри». Около 40% браков заканчиваются разводом, и эта статистика гораздо более показательна с точки зрения судьбы любого конкретного брака, чем влюбленно-восторженные взгляды. На церемонии делиться данным пониманием не стóит.

Среди недавних методов избавления от предрасположенности к определенным оценкам наиболее перспективными ученые сочли ряд видеоигр. Они возникли после войны в Ираке и приведшего к ней катастрофического просчета с оружием массового уничтожения, который расшатал основы всего разведывательного сообщества. В 2006 году, стремясь предотвратить еще одну ошибку схожего масштаба, правительство США создало Агентство передовых исследований в сфере разведки (IARPA) с целью использования новейших технологий для улучшения процесса сбора и анализа разведывательных данных. В 2011 году IARPA разработала программу под названием «Сириус» для финансирования развития «серьезных» видеоигр, которые могли смягчить или бороться с тем, что считается шестью наиболее пагубными когнитивными искажениями: предвзятость подтверждения, фундаментальная ошибка атрибуции, слепое пятно в отношении когнитивных искажений (тенденция никак не компенсировать свои собственные предубеждения), эффект привязки, эвристика репрезентативности и проективное искажение (предположение о том, что мышление окружающих идентично вашему собственному).

Целью разработки таких игр задались шесть команд, но до финиша дошли лишь две. Наибольшее внимание получила та, которой руководил Кэри Мореведж, ныне профессор Бостонского университета. Совместно с сотрудниками компаний «Криэйтив Технолоджис» и «Лейдос» Мореведж разработал игру «Пропавшая без вести» (Missing). Одни субъекты играли в игру, прохождение которой занимает около трех часов, а другие смотрели видео о когнитивных искажениях. Все они прошли тестирование на навыки смягчения предрасположенности к определенным оценкам до тренировки, сразу после нее и, наконец, спустя 8-12 недель.

После прохождения теста я сыграл в игру, где представлено множество мужчин и женщин в облегающей одежде и не лучшим образом ориентирующихся в окружающем мире. Игрок принимает образ соседки женщины по имени Терри Хьюз, которая таинственным образом пропала без вести в первой части игры. Во второй же она вновь появилась и нуждается в помощи, чтобы разобраться с происходящими в ее компании махинациями. По пути вас просят делать суждения и прогнозы, некоторые из которых имеют отношение к истории, а некоторые — нет, и все они призваны выявить арсенал ваших предубеждений. В соответствии со своими ответами вы тут же получаете замечания и комментарии.

© AFP 2017, Mauricio LimaЧелвеческий мозг на выставке в Сан-ПаулуНапример, когда вы обыскиваете квартиру Терри, в дверь стучит комендант здания и ни с того ни с сего спрашивает о Мэри, другом арендаторе, которого называет человеком неспортивным. Он говорит, что 70% арендаторов ходят в спортзал «У Рокки», 10% — в «Энтропи фитнес», а остальные 20% остаются дома и смотрят «Нетфликс». Как вы думаете, спрашивает он, в какой спортзал, вероятнее всего, ходит Мэри? Неверный ответ, основанный на игнорировании базовой информации (форма эвристики репрезентативности), звучит как «Ни в какой. Мэри — диванный боец». Правильный ответ основан на данных, любезно предоставленных комендантом: тренажерный зал «У Рокки». Когда участников исследования опросили сразу после игры или просмотра видео, а затем через пару месяцев, все улучшили свой результат, причем у игравших он оказался выше.

Когда я разговаривал с Мореведжем, он сказал, что считает результаты подтверждением исследований и идей Ричарда Нисбетта. «Работа Нисбетта в значительной степени основана на предположении о том, что обучение не способно уменьшать склонность к определенным оценкам, — сказал он мне. — Литература по разного рода методикам обучению говорит, что книги и занятия по сути неэффективны, хоть и являются прекрасным развлечением. А вот от игры воздействие гораздо больше. Это удивило всех».

Вскоре после завершения игры я снова прошел тест и показал смешанные результаты. Выявилось заметное улучшение с точки зрения предвзятости подтверждения, фундаментальной ошибки атрибуции и эвристики репрезентативности и небольшое — в контексте слепого пятна в отношении когнитивных искажений и эффекта привязки. Самый низкий первоначальный балл (44,8%) я показал в проективном искажении. После игры он даже немного снизился. (Мне действительно нужно перестать думать, что все мыслят в точности как я.) Но даже положительные результаты напомнили мне слова Даниела Канемана: «Анкеты меня не убеждают. Тест можно дать даже спустя пару лет, но ведь он дает тестируемому подсказки и напоминает, о чем вообще речь».

Я прошел тесты Нисбетта и Мореведжа на мониторе компьютера, а не на бумаге, но суть от этого не меняется. Одно дело, когда эффект от обучения проявляется в виде улучшенных результатов при тестировании, и совсем другое — когда эффект проявляется в виде поведения в реальных условиях. Мореведж сказал мне, что некоторые ориентировочные пути решения задач реальной сложности по ходу игры в «Пропавшую без вести» предоставили «многообещающие результаты», но говорить о них пока слишком рано.

Я не такой пессимист, как Даниел Канеман, и не такой оптимист, как Ричард Нисбетт, но несколько изменений в своем поведении заметил. Например, недавно была жара, и я решил купить в торговом автомате бутылку воды за два доллара. Бутылка не выпала, ввиду поломки механизма, удерживающего ее на месте. Однако рядом был еще один ряд бутылок с водой, и, очевидно, в этом ряду механизм был исправен. Мой инстинкт заключался в том, чтобы не покупать бутылку из «хорошего» ряда, поскольку стоила она вдвое больше. Но все мои познания в области когнитивных искажений говорили, что данное мышление ошибочно. Я бы потратил за воду два доллара — цена, которую был готов заплатить, как уже было установлено. Так что я внес деньги, получил воду и с радостью ее выпил.

В дальнейшем я приложу все усилия, чтобы следить за своими мыслями и реакциями. Допустим, я ищу научного ассистента. Кандидат А имеет безупречные рекомендации и опыт, но оказывается косноязычным и не способным смотреть в глаза; кандидат Б любит говорить о баскетболе — моя любимая тема! — но рекомендации у него как минимум посредственные. Смогу ли я преодолеть фундаментальную ошибку атрибуции и нанять кандидата А?

Или, скажем, есть некий чиновник, которого я презираю из-за характера, поведения и идеологии, но под его началом экономика страны отличается высокой эффективностью. Смогу ли я избавиться от сильной предвзятости подтверждения и хотя бы допустить возможность того, что этот человек заслуживает доверия?

Что касается вопроса, который Хэл Хершфилд поднял в первую очередь — планирование порядка распоряжения наследуемым имуществом, — я всегда был похож на муравьев, которые делают запасы на зиму, пока кузнечики поют и резвятся. Но экономить я умею столь же хорошо как и откладывать все в долгий ящик. Несколько месяцев назад мой финансовый советник предложил бесплатно оценить мое завещание, составленное пару десятилетий назад и, безусловно, нуждавшееся в пересмотре. В процессе составления завещания есть нечто такое, что создает целую бурю предрассудков, начиная с эффекта неоднозначности (когда «принятие решения страдает из-за недостатка информации или неоднозначности», согласно определению Википедии) и заканчивая искажением нормальности (склонность забывать о самосохранении в экстренной ситуации), а кульминацией всего выступает эффект страуса (правда нужно объяснять?). Мой советник прислал мне предоплаченное письмо, которое до сих пор лежит на полу моего кабинета и собирает пыль. И как подсказывает мне склонность к запоздалым суждениям, я знал, что именно так и произойдет.

Материалы ИноСМИ содержат оценки исключительно зарубежных СМИ и не отражают позицию редакции ИноСМИ.

Список когнитивных искажений — Традиция

Материал из свободной русской энциклопедии «Традиция»